Model Configurations:Recurrent Neural Network (RNN)

Model > Configurations

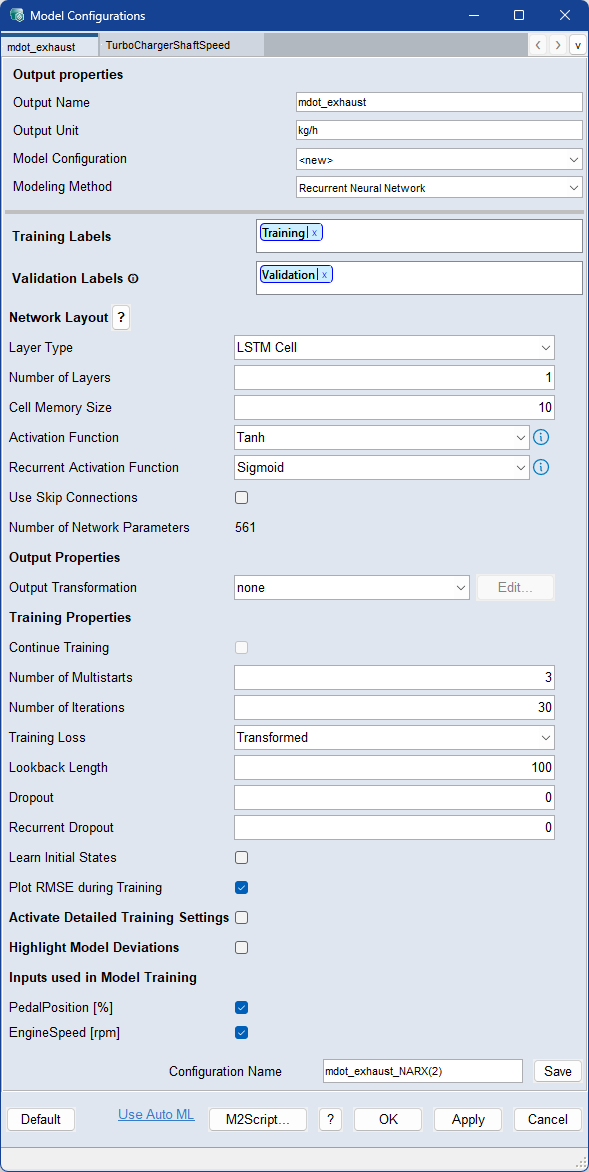

モデリングメソッド Recurrent Neural Network が選択されていると、<output> タブの Model Configuration 領域には以下のエレメントが含まれます。出力ごとに個別のタブがあります。

Output Properties 領域とウィンドウ最下部のボタン行についての説明は、 Model Configurations (ASCMO-DYNAMIC)を参照してください。

Training Labels

モデルトレーニングを行いたいラベルを割り当てます。複数のラベルを使用する場合は、1つ以上のラベルに関連するすべてのデータが使用されます。

ラベルを割り当てるには、フィールドをダブルクリックして名前をキー入力します。リストに提示されたデータセットから選択することができます。

ラベルを削除するには、ラベルの x、または Del を使用します。

Validation Labels

検証データとして使用したいデータのラベルを割り当てます。複数のラベルを使用する場合は、1つ以上のラベルに関連するすべてのデータが使用されます。

ラベルを割り当てるには、フィールドをダブルクリックして名前をキー入力します。リストに提示されたデータセットから選択することができます。

ラベルを削除するには、ラベルの x、または Del を使用します。

|

注記 |

|---|

|

いずれのデータにも検証ラベルが割り当てられていない場合は、検証なしでトレーニングが行われます。ログウィンドウにメッセージが表示されます。Manage Datasets ウィンドウで、ラベルをデータに割り当てることができます。 |

Network Layout

Number of Layers

層の数を入力します。

Cell Memory Size

ニューラルネットワークのノード当たりのセルメモリサイズを入力します。一般的な値の範囲は[5, 20]です。実際のメモリセルのサイズはセルタイプに依存します。

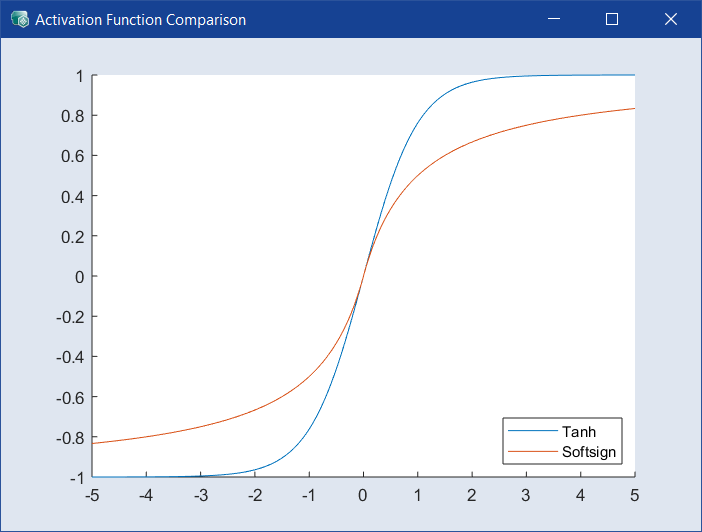

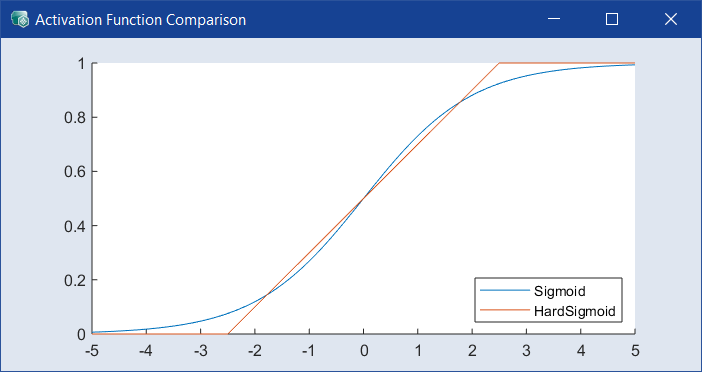

すべての層で使用される活性化関数を選択します。デフォルトは Tanh で、別の関数を使うと、精度は落ちても計算効率が良くなる可能性があります。ドロップダウンの隣の ![]() をクリックすると、

をクリックすると、 Activation Function Comparison ウィンドウ が開きます。

Activation Function Comparison ウィンドウ が開きます。

すべての層で使用されるリカレント活性化関数を選択します。デフォルトは Sigmoid で、別の関数を使うと、精度は落ちても計算効率が良くなる可能性があります。ドロップダウンの隣の ![]() をクリックすると、

をクリックすると、 Activation Function Comparison ウィンドウ が開きます。

Activation Function Comparison ウィンドウ が開きます。

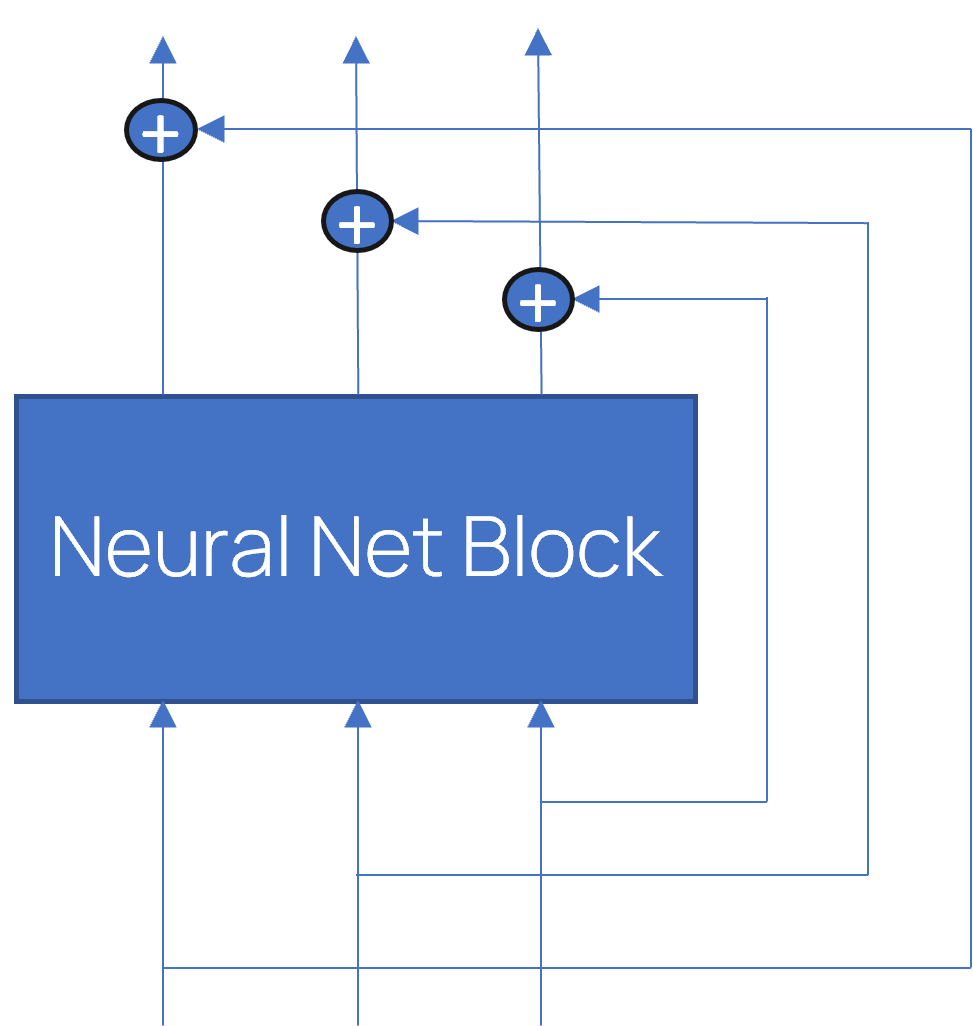

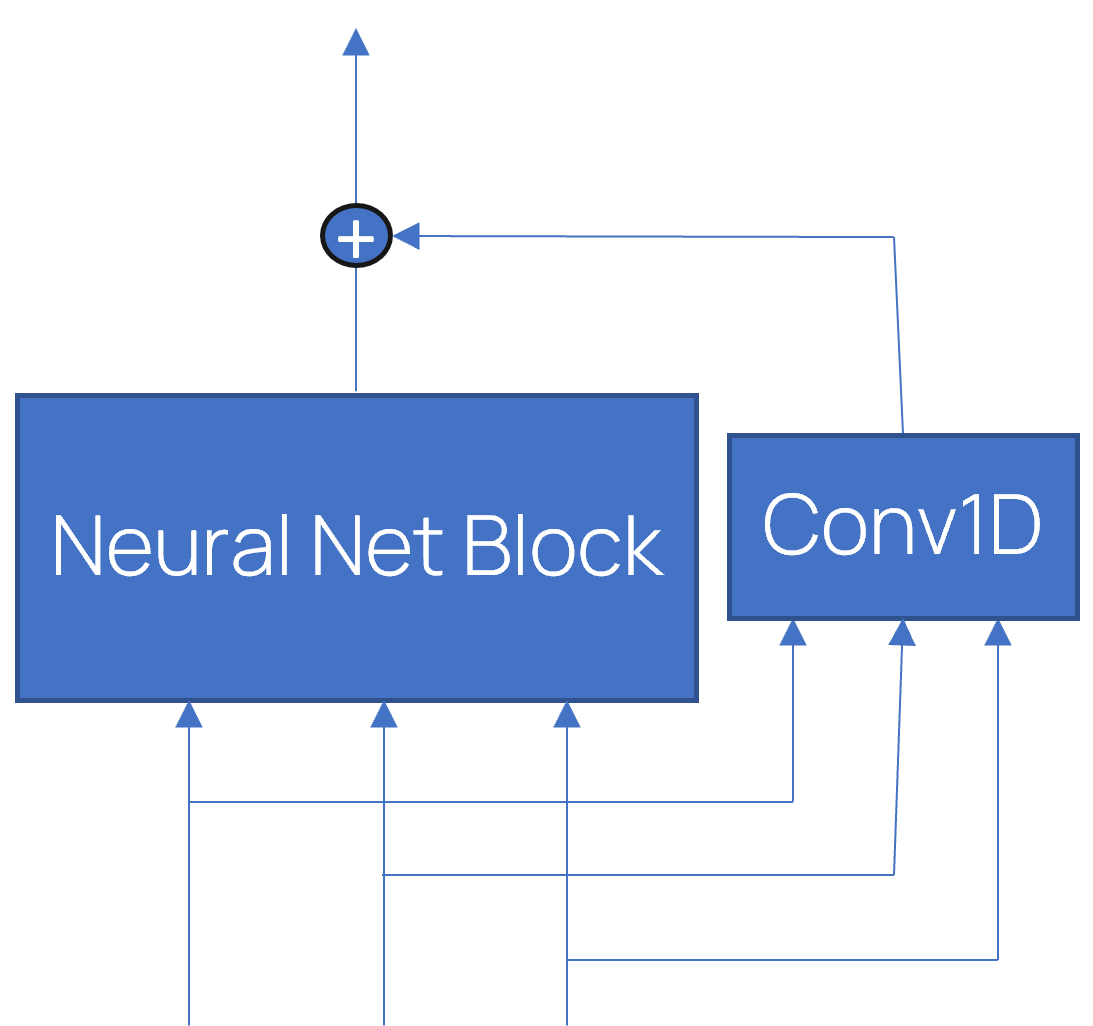

Use Skip Connections

層の入力をその出力に加えるには、これをオンにします。

入力と出力のサイズが一致しない場合、入力は追加の畳み込み層で処理されてから出力に追加されます。スキップ接続は、選択された層をスキップして情報を流すことを可能にするもので、トレーニングを簡素化し、ネットワークのパフォーマンスを向上させることが示されています。

Number of Network Parameters

現在の設定

Output Properties

Output Transformation

出力の変換タイプを選択します。変換を利用することによりモデル予測を改善できます。トレーニングデータの値に負またはゼロが含まれる場合、一部の変換は使用不可となります。

以下から選択できます:

- none - 変換なし

- log(y) - 対数

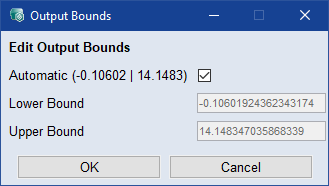

Bounded:上下限値内に制限されます。

Edit をクリックして自動的に選択された上下限値を

表示、または手動で下限値と上限値を定義することができます。これらを手動で定義するには、Automatic チェックボックスをオフにします。上下限値はトレーニングデータの範囲内である必要があります。

表示、または手動で下限値と上限値を定義することができます。これらを手動で定義するには、Automatic チェックボックスをオフにします。上下限値はトレーニングデータの範囲内である必要があります。log(y+c):対数 + 定数

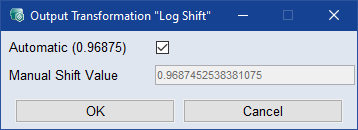

Edit をクリックして自動的に選択された対数シフトを

表示、または手動でシフト値を定義することができます。これを手動で定義するには、Automatic チェックボックスをオフにします。

表示、または手動でシフト値を定義することができます。これを手動で定義するには、Automatic チェックボックスをオフにします。

Training Properties

Continue Training

新しいトレーニングを開始する代わりに、可能であれば既存のモデルトレーニングと反復を続行するには、このオプションをオンにします。Training Properties を変更して続行することができます。

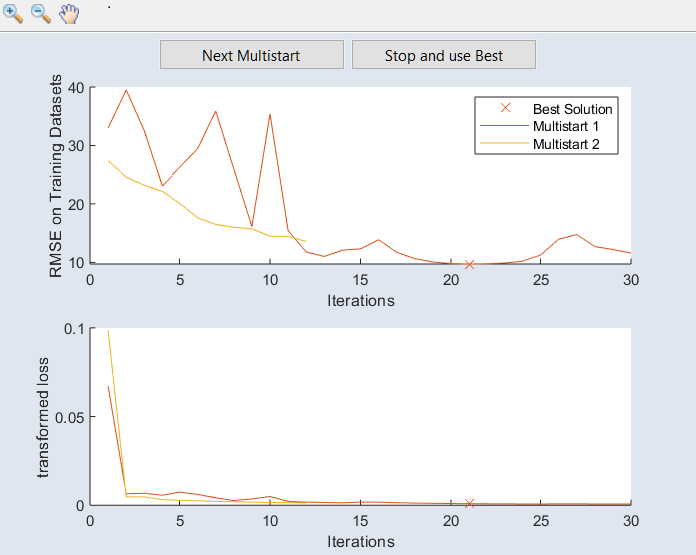

Number of Multistarts

異なる開始値で行う反復の回数を入力します。値が大きいとモデル品質が向上しますが、モデルトレーニングの所要時間が長くなります。デフォルトは3です。

モデルトレーニングにおいて実施する反復回数を入力します。検証データで10回反復してもモデル性能が向上しない場合、トレーニングは中止されます。ディープラーニングにおいて、これはよく「エポック数」と呼ばれます。

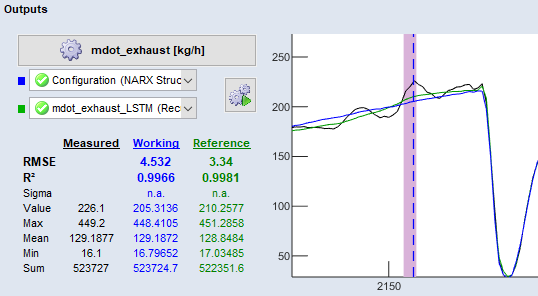

Training Loss

トレーニング不足のタイプを選択します。トレーニング不足は、モデルトレーニングの実行中に最小化される目標です。

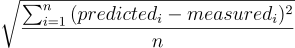

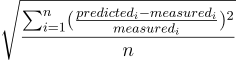

Absolute はRMSE演算と等しくなります:

Relative は測定値と関連付けます:

Transformed は Absolute に似ていますが、変換された空間においてトレーニング不足の計算を行うので、出力変換に依存します。

データを分割した配列のサイズを入力します。基盤となるオプティマイザは、ここで指定された長さに固定されたバッチを取得します。デフォルトは100です。

現在のデータの長さがこの程度のステップ数以下であれば、Lookback Length=100での最適化も可能ですが、スニペット長をより短くすることをお勧めします。値が小さいほどトレーニングが速くなります。

トレーニング中にランダムに非活性化するニューロンの割合を、0~0.9の範囲で入力します。非活性化は、ニューロンの重みを一時的に0にするものです。これにより、過剰適合(オーバーフィッティング)を回避することができます。入力された値が0の場合は非活性化されず、0.1にすると10%のニューロンが一時的に0に設定されます。一般的な値の範囲は[0, 0.2]です。

トレーニング中に非活性化するリカレント状態のニューロンの割合を、0~0.9の範囲で入力します。非活性化は、ニューロンの重みを一時的に0にするものです。これにより、過剰適合(オーバーフィッティング)を回避することができます。入力された値が0の場合は非活性化されず、0.1にすると10%のニューロンが一時的に0に設定されます。一般的な値の範囲は[0, 0.2]です。

Learn Initial States

このチェックボックスがオンの場合、最初の時間ステップの入力値と出力値に基づいてRNNモデルの初期状態が学習されるため、初期予測は与えられた出力と一致します。

モデルのエクスポート時に、希望する初期出力を定義することができます。

Plot RMSE during Training

トレーニングデータと検証データのRMSE値を モデルトレーニング中に表示したい場合は、オンにします。

モデルトレーニング中に表示したい場合は、オンにします。

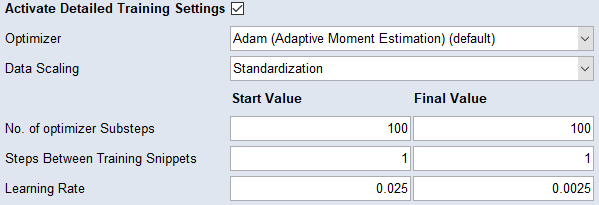

Activate Detailed Training Settings

チェックボックスをオンにすると、 Detailed Training Settings セクションが表示されます。

Detailed Training Settings セクションが表示されます。

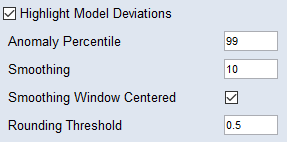

Highlight Model Deviations

オンにすると、モデル偏差が プロット上で赤くハイライトされます。

プロット上で赤くハイライトされます。

ハイライト表示に関して以下のような詳細設定が行えます:

Anomaly Percentile

正常とされる再構成誤差の百分位数を入力します。モデル選択に検証データセットが使用されている場合は、この値は検証データに基づいて計算され、そうでない場合はトレーニングデータに基づいて計算されます。値は異常スコアの0.5にマッピングされます。

Smoothing

メディアンフィルタのステップ数として、データポイントのウィンドウサイズの値を入力します。異常予測のため、信号が平滑化されます。これによって、より良い結果が導き出されます。

Smoothing Window Centered

スムージングウィンドウの中心を評価点にしたい場合、つまり未来の点も考慮したい場合は、オンにします。オフにすると、スムージングウィンドウでの計算に過去のポイントのみが使用されます。

Rounding Threshold

異常予測しきい値(その値を下回るとモデルの予測値が自動的に0に設定され、それ以外は1になります)を入力します。しきい値は、Receiver Operating Characteristic(Model > Anomaly Detection: Receiver Operating Characteristic)に表示されます。

Inputs used in Model Training

この領域にはモデルのすべての入力が表示されます。ここで各入力をモデルトレーニングに含めるかどうかを指定することができます。

デフォルトにおいては、すべての入力が含まれます。

参照

Model Configurations (ASCMO-DYNAMIC)

再帰型ニューラルネットワーク(Recurrent Neural Networks)によるモデル予測

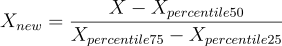

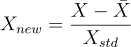

を [-1, 1] に含まれる長さ 1 の区間にスケーリングします。

を [-1, 1] に含まれる長さ 1 の区間にスケーリングします。